L'utilizzo di ChatGPT nel robot Nao si inserisce in un progetto e una sperimentazione di ampio respiro che ha lo scopo di integrare le intelligenze basate su Large Language Models (LLMs) e le Intelligenze Artificiali generative nei robot sociali per un'interazione più fluida uomo-robot. Le preoccupazioni oggi espresse dal Garante sono state ampiamente anticipate e discusse nel corso del seminario, in cui si è più volte ribadita la necessità di adottare soluzioni attente ai diritti della persona, per una robotica e una Intelligenza Artificiale human-centred.

«ChatGPT è un sistema addestrato a leggere milioni di articoli, pagine web, una mega enciclopedia. Come se avessimo costretto 10 persone a leggere per tutta la vita… Ha dei limiti perché è un sistema linguistico contestualizzato e può creare il sommario di un testo, dare definizioni e spiegazioni» - ha spiegato Cangelosi in collegamento da Manchester.

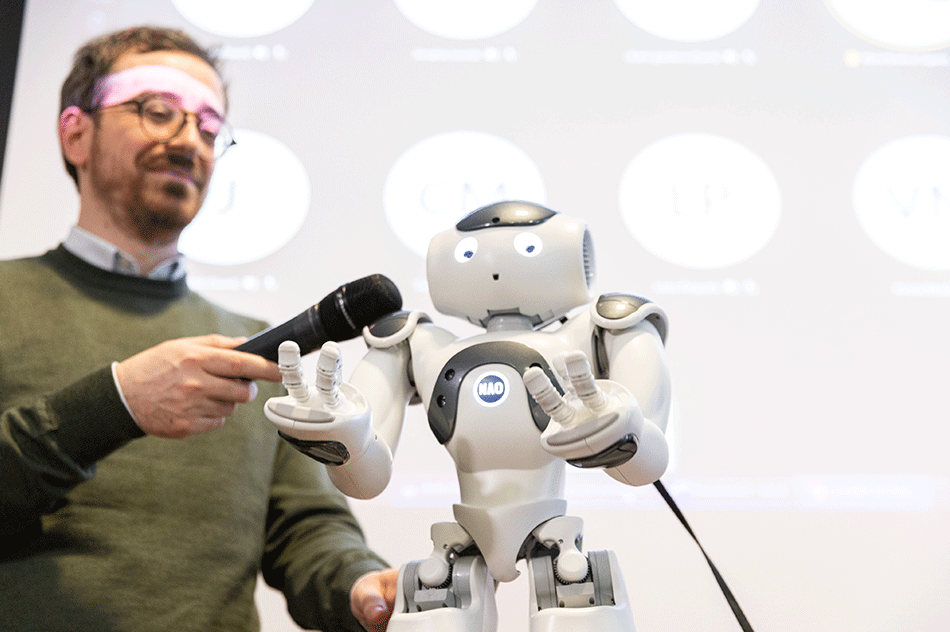

La Chat è basata su un modello di apprendimento automatico sviluppato da OpenAI, sistema specializzato in conversazioni con un utente umano. Certamente i rischi di un uso non corretto ci sono, ma abbiamo un Nao conversatore non più limitato da ciò che noi gli diciamo di dire ma molto stimolato dalle domande di chi lo interroga. Deve essere usato per il bene e chi mette i paletti deve aver chiaro cos’è il bene, come la tutela della privacy e delle minoranze».

In aula i partecipanti curiosi hanno assistito a una bella dissertazione sulle stagioni in risposta alla domanda su cosa fossero, non senza un’esitazione iniziale per raccogliere da ChatGPT tutte le informazioni necessarie. Sorprendenti, poi, le risposte alla richiesta di consigli sulle possibili mete per le vacanze, perché Nao ha suggerito criteri per discernere vacanze low cost, rinunciando al lusso pur garantendo una bella esperienza. O ancora, di fronte al dilemma su come comportarmi di fronte alla persona che mi ha regalato un libro quando io invece volevo un monopattino, Nao ha fatto notare come un regalo debba sempre essere gradito perché frutto di un gesto gentile.

Cortese, preciso e affabile, dunque, questo robot rappresenta l’ultima frontiera dell’intelligenza artificiale, ma occorre sottolineare che non ha un’autocoscienza, «per questo la persona deve essere sempre messa al centro e la chat orientata al bene, alla civiltà e alla trasparenza» - ha specificato Marchetti -. Il prossimo passo evolutivo auspicabile sta nella possibilità che il robot dia l’impressione alla persona con cui interagisce di tenere traccia di quello che l’altro dice, come in una relazione tra esseri umani dove l’attenzione all’altro è fondamentale.

«La Chat usa il contesto delle precedenti interazioni per riconoscere i significati delle parole, ovvero il dialogo precedente è usato come contesto per rispondere alle nuove domande - ha precisato Cangelosi - . Ad esempio, se prima ho parlato di cani e ora parlo di gatti, la Chat sa che sto parlando di animali. Noi cerchiamo di insegnare ai robot i significati delle parole anche se questo è difficile con i concetti astratti».

Gli artefatti tecnologici come Nao danno un senso di presenza perchè sono fisici, antropomorfizzano lo sguardo, catturano con la fisicità. E per progettarlo i ricercatori si sono ispirati alla relazione uomo -uomo. Proprio l’antropomorfizzazione «è il primo aspetto a cui abbiamo fatto attenzione - ha dichiarato Davide Massaro, professore di Psicologia dello Sviluppo e Psicologia dell’Educazione -. Il secondo è stato il comportamento. Infatti, ci aspettiamo che il robot agisca attraverso sequenze comportamentali il più possibile simili a quelle umane. Infine, il terzo aspetto è costituito dagli stati mentali, ovvero ci siamo interrogati su come sia replicabile uno stato mentale all’interno di un robot e, d’altra parte, come noi, interagendo con questi agenti robotici, tendiamo ad attribuire loro degli stati mentali come facciamo con gli esseri umani». La sperimentazione è avvenuta innanzitutto negli asili nido con forme di interazione attraverso il canale sensoriale e motorio dell’artefatto robotico.

«Nei primi mesi di vita i bambini sono capaci di percepire i robot come attori sociali - ha raccontato Manzi sulla base di studi già realizzati -. A 17 mesi sono in grado di seguire lo sguardo dell’adulto e così fanno con i robot. Dal punto di vista cognitivo e sociale il bambino comprende quello che fa il robot e volte lo anticipa. I piccoli sono ingaggiati dalla corporeità».

Nel caso dei bambini più grandi la fattezza simil-umana diventa importante ma più problematica è la vicinanza con l’aspetto mentale. «Dalle nostre ricerche è emerso che il robot non è mai all’altezza dell’uomo» - ha specificato la psicologa dello sviluppo e dell’educazione Cinzia Di Dio.

In uno studio sull’acquisizione, la perdita e la riconquista della fiducia nei bambini da 3 a 9 anni si è visto che il comportamento nei confronti del bambino o del robot era lo stesso. «Quando il partner era accurato nella sua scelta, il bambino si allineava e imparava a fidarsi dell’altro e lo stesso nelle fasi di perdita della fiducia e di riacquisizione - ha continuato Di Dio -. La fiducia si basa su un’interazione dialogica. Se dico qualcosa di diverso da quello che faccio vado a minare la fiducia. Ai robot dovremmo poter attribuire due termini fondamentali: affidabilità e trasparenza. Se riuscissimo a dotare il robot di un sistema conversazionale, lui potrebbe argomentare i motivi che sottendono le sue scelte, decisioni, i suoi consigli perchè questo lo renderebbe trasparente ai nostri occhi».

Un'ultima provocazione ha riguardato l'uso di un robot con ChatGPT in università. Potrà interrogare? «Si può insegnargli a fare le domande corrette ma lui non saprà mai che le sta facendo» ha concluso Marchetti -. Questa è la differenza di potenziale tra uomo e robot. «Un buon professore è come Socrate, fa uscire la conoscenza che tu hai e non sai di avere, se ti interroga in modo adeguato. Questa è la maieutica. Trasmettere conoscenze, valutarle nel modo più equo possibile e nel modo giusto, sintonizzandosi sulle abitudini delle persone nelle loro culture». Tutto questo è un Maestro, e il robot non potrà mai esserlo.